Forschung im Bereich Künstliche Intelligenz

Die Anwendung von Methoden des maschinellen Lernens, insbesondere tiefen neuronalen Netzen, ist seit vielen Jahren ein Schwerpunkt der Forschung von Mitgliedern des Fachbereichs Technik.

Auf der theoretischen Seite wurde untersucht, wie evolutionäre Algorithmen zum Training neuronaler Netzwerke verwendet werden können, siehe z. B. [1 – 3]. Es gab auch eine Beteiligung am BIG-bench-Projekt (https://github.com/google/BIG-bench), das untersucht, wie gut Transformer-Netzwerke ein breites Spektrum an Aufgaben lösen können und kürzlich eine viel zitierte Publikation zum Ergebnis hatte [4].

Anwendungen, die bisher im Vordergrund standen, sind konversationelle Agenten [5, 6], das Erlernen von Kompositionsregeln aus musikalischen Korpora [7], das Erkennen von Zeichen der Gebärdensprache [8] und selbsfahrende Kraftfahrzeuge [9].

Im Fachbereich gibt es Lehre zum Thema tiefe neuronale Netze (siehe z. B. https://github.com/benjamininden/AI-teaching-python), und es sind schon einige Abschlussarbeiten entstanden. Derzeit interessieren wir uns u. a. für die Verwendung von Transformer-Netzwerken in der Lehre, z. B. zur automatischen Erzeugung von Studienfragen [11] und zum automatischen Bewerten kurzer Antworten auf Prüfungsfragen [12, 13].

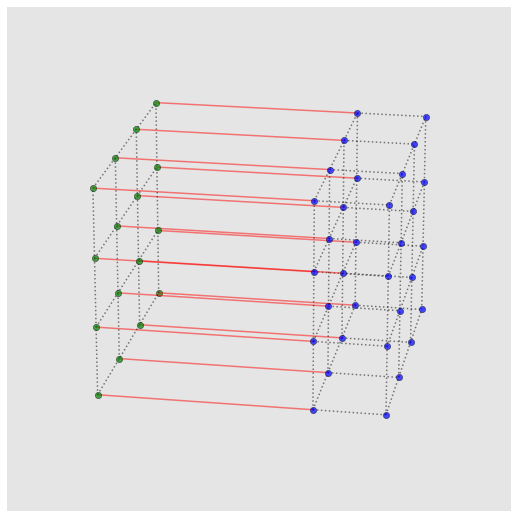

Ein weiteres unserer Forschungsthemen mit KI-Bezug sind Suchalgorithmen für Fälle, in denen mehrere Agenten mehrere bewegliche Ziele finden müssen [10].

Zitierte Publikationen von Gruppenmitgliedern:

[1] Inden, B., Jin, Y., Haschke, R. & Ritter, H. 2012. “Evolving neural fields for problems with large input and output spaces”. Neural Networks, 28, 24 – 39. https://doi.org/10.1016/j.neunet.2012.01.001

[2] Inden, B., Jin, Y., Haschke, R., Ritter, H. & Sendhoff, B. 2013. “An examination of different fitness and novelty based selection methods for the evolution of neural networks”. Soft Computing, 17(5), 753–767. https://doi.org/10.1007/s00500-012-0960-z.

[3] Inden, B. & Jost, J. 2019. “Evolving neural networks to follow trajectories of arbitrary complexity”. Neural Networks, 116, 224–236. https://doi.org/10.1016/j.neunet.2019.04.013.

[4] Srivastava, A., Rastogi, A., Rao, A., Shoeb, A.A.M., Abid, A., Fisch, A., Brown, A.R., … Inden, B. et al. 2022. “Beyond the Imitation Game: Quantifying and extrapolating the capabilities of language models”. arXiv preprint arXiv:2206.04615. https://arxiv.org/abs/2206.04615.

[5] Inden, B., Malisz, Z., Wagner, P. & Wachsmuth, I. 2012. “Rapid entrainment to spontaneous speech: A comparison of oscillator models”, in: N. Miyake, D. Peebles, & R.P. Cooper (Eds.), Proceedings of the 34th Annual Conference of the Cognitive Science Society. Austin, TX: Cognitive Science Society. https://escholarship.org/uc/item/0c905908.

[6] Inden, B., Malisz, Z., Wagner, P., & Wachsmuth, I. 2013. “Timing and entrainment of multimodal backchanneling behavior for an embodied conversational agent”, in: J. Epps, F. Chen, S. Oviatt, K. Mase, A. Sears, K. Jokinen, et al. (Eds), Proceedings of the 15th International Conference on Multimodal Interaction, ICMI'13 - Sydney. New York: ACM. https://doi.org/10.1145/2522848.2522890.

[7] Anders, T. & Inden, B. 2019. “Machine learning of symbolic compositional rules with genetic programming: Dissonance treatment in Palestrina”, PeerJ Computer Science 5:e244. https://doi.org/10.7717/peerj-cs.244.

[8] Mistry, J. & Inden, B. 2018. “An approach to sign language translation using the Intel RealSense camera”, in: 10th Computer Science and Electronic Engineering Conference (CEEC'18), University of Essex, Colchester, 19–21 September 2018. https://doi.org/10.1109/CEEC.2018.8674227.

[9] Jiang, X., Namokel, M., Wu, J., Wang, L., Wu, X. 2023. “Research on Driverless Vehicle”, in: Wang, Y., Yu, T., Wang, K. (eds) Advanced Manufacturing and Automation XII. IWAMA 2022. Lecture Notes in Electrical Engineering, vol 994. Springer, Singapore. https://doi.org/10.1007/978-981-19-9338-1_51

[10]. Afzalov, A., Lotfi, A., Inden, B. & Aydin, M. E. 2022. “A Strategy-Based Algorithm for Moving Targets in an Environment with Multiple Agents”. SpringerNature Computer Science 3, 435. https://doi.org/10.1007/s42979-022-01302-x.

Zitierte Publikationen von Anderen:

[11] Lopez, L. E., Cruz, D. K., Cruz, J. C. B. & Cheng, C. 2020. “Transformer-based end-to-end question generation”. ArXiv:2005.01107.

[12] Pado, U. & Kiefer, C. 2015. “Short answer grading: When sorting helps and when it doesn't”, in: Proceedings of the 4th workshop on NLP for Computer Assisted Language Learning at NODALIDA 2015.

[13] Horbach, A., Stennmanns, S. & Zesch, T. 2018. “Cross-Lingual Content Scoring”, in: Proceedings of the Thirteenth Workshop on Innovative Use of NLP for Building Educational Applications, pages 410-419.